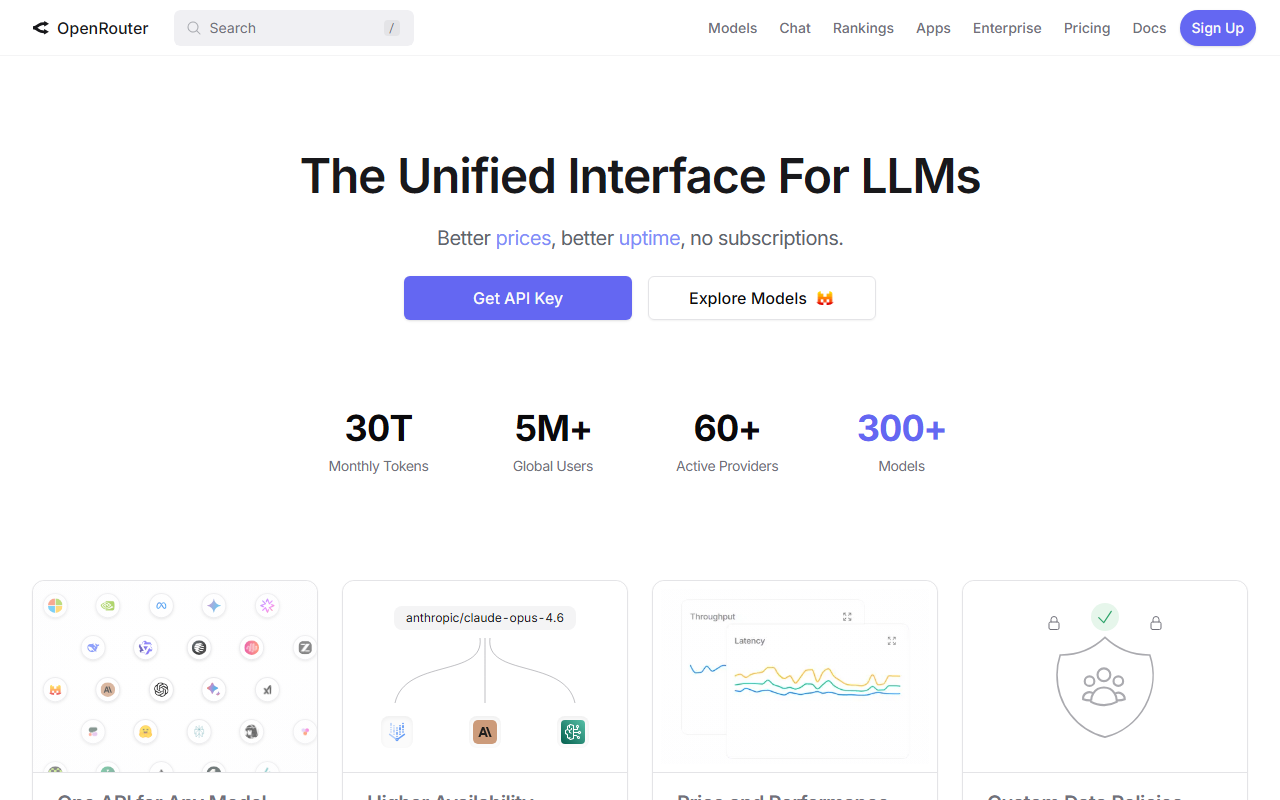

第一印象与入门体验

访问 openrouter.ai 上的 OpenRouter 时,着陆页立即传达了其核心价值主张:一个统一API即可访问数百种语言模型。首页突出展示了令人印象深刻的指标——每月处理70万亿个token、全球超过500万用户、来自60多家提供商的300多个模型。注册流程异常简单。我点击完成了三步:创建账户(使用Google、GitHub甚至MetaMask)、购买积分(我测试了最低10美元的选项)、获取API密钥。仪表盘随后呈现出一个清晰的界面,包含模型探索、使用分析和API密钥管理。最突出的是其简洁性:该API完全兼容OpenAI,意味着我只需更改基础URL和API密钥,即可使用现有的OpenAI SDK集成。整个入门过程不到五分钟,我就能在同一个会话中向来自Anthropic、Google、Meta等公司的模型发出请求。

核心功能与技术性能

OpenRouter的主要优势在于统一访问。开发者无需为每个提供商管理单独的API密钥、计费和速率限制,只需一个端点即可。该平台提供智能模型路由:如果主提供商挂掉,请求会自动回退到托管同一模型的另一个提供商。在测试中,我特意针对一个偶尔出现故障的模型;回退过程无缝衔接,没有明显延迟增加。基于边缘的基础架构号称延迟极低,在我从美国连接的测试中,响应时间与直接提供商API不相上下。另一个让我印象深刻的功能是精细的数据策略控制。在数据策略标签页下,我可以限制哪些提供商处理包含敏感信息的提示——这对企业合规非常有用。此外,OpenRouter还提供实时模型路由可视化,展示流量如何在提供商之间分布。该平台还为Replit的AI和Hermes Agent等智能体提供支持,证明了其在生产环境中的可靠性。

定价模式与实际使用

OpenRouter采用基于积分的系统,而非订阅制。你可以购买积分(例如10美元、99美元),每次API调用根据每个模型的token定价扣除积分。这很灵活:你可以混合使用昂贵的尖端模型和更便宜的模型,无需承诺月度套餐。然而,没有免费层级——每个请求都会消耗积分。对于进行快速原型开发的开发者来说,与提供免费使用限额的提供商(如OpenAI注册时赠送5美元免费积分)相比,这可能是一个劣势。定价透明度尚可:每个模型页面都列出了每token的成本,账单历史也很容易查看。我注意到了一个限制:在团队成员之间管理预算需要创建组织,并且积分分配不如某些企业平台那么精细。另外,由于定价会随提供商库存波动,成本可能随时变化——不过OpenRouter确实在模型探索器中清晰显示了当前费率。

市场定位与推荐

OpenRouter与LiteLLM和AI Proxy等工具一样,属于模型网关。与通常需要自托管且配置繁重的LiteLLM不同,OpenRouter是一种完全托管的服务,内置了回退和数据策略。与直接使用OpenAI API相比,OpenRouter提供更广泛的模型选择和更好的正常运行时间(通过回退机制)。然而,它在提供商的定价基础上略有加价,并且你失去了对提供商特定功能(例如Anthropic的扩展思考)的直接控制。该平台非常适合需要快速跨模型实验、构建智能体系统(如其集成所示)或需要合规驱动的提供商过滤的开发者及团队。它不太适合那些工作负载非常可预测且量大,可以从直接提供商折扣中受益的场景。总体而言,OpenRouter兑现了其统一LLM接口的承诺,拥有出色的可靠性。我推荐它用于任何需要正常运行时间和灵活性高于每token最后几分钱的多模型项目。

请访问 https://openrouter.ai/ 亲自探索OpenRouter。

评论