第一印象与上手引导

访问 ThirdAI 网站,最直接的信息是:在 CPU 上实现生产级 GenAI,支持气隙部署并大幅降低成本。着陆页简洁且面向企业用户,突出显示“联系我们的”或预约咨询的按钮。没有公开注册或免费试用入口,而是引导用户申请演示。这表明 ThirdAI 完全定位为企业级解决方案,而非面向个人开发者的自助工具。

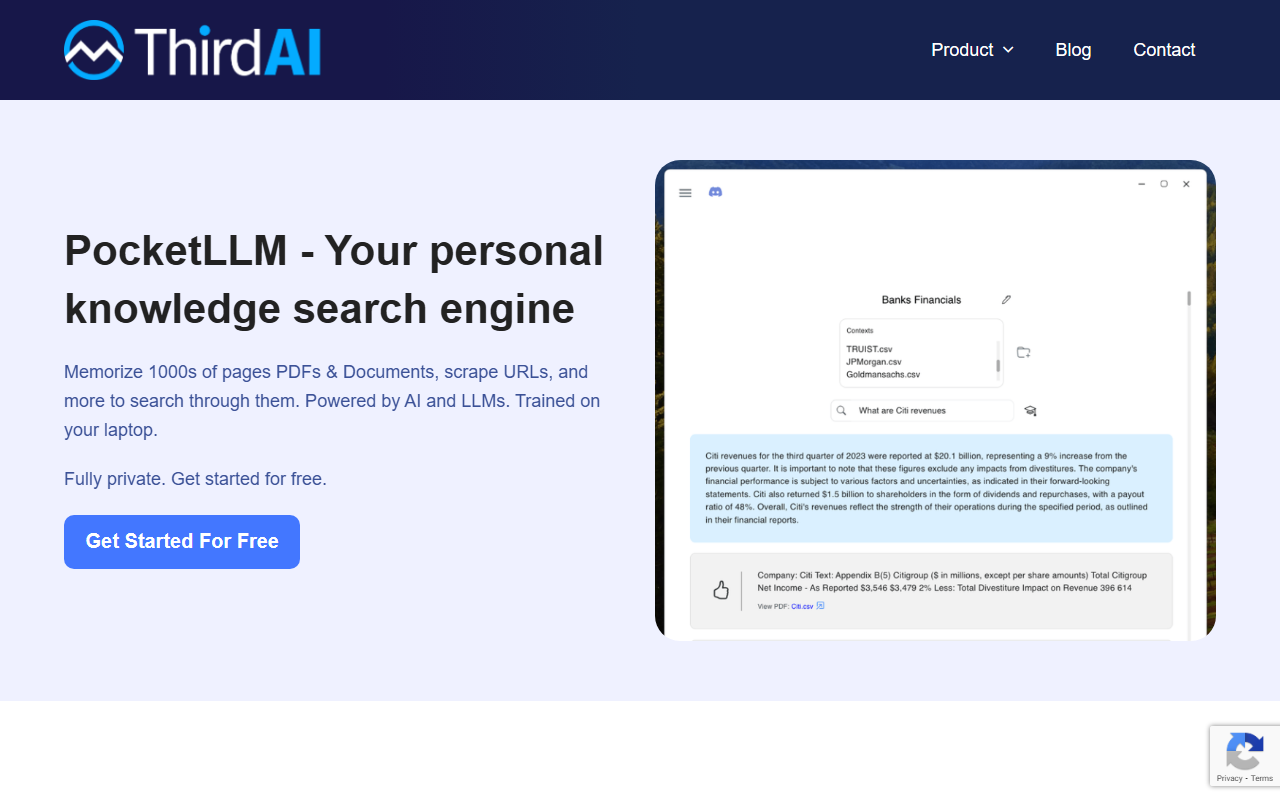

控制面板不对外公开,但从产品演示选项卡(Compose、Run、Customize)来看,该平台提供了一个用于构建 AI 应用的无代码界面。平台声称可省去分块、解析、嵌入、向量数据库、重排序和微调等繁琐环节。对于新用户而言,这意味着比组装独立库更简单的工作流程。根据网站说明,上手流程很可能包括与团队咨询,随后在数小时内构建原型,数周内上线生产应用。

技术与用例

ThirdAI 的核心差异化在于能够在标准 CPU 基础设施上运行,无需专用 GPU 服务器。网站引用了一种“模拟人脑稀疏性”的技术,无论模型大小如何,都能实现低延迟(数毫秒)。这是一个大胆的声明,虽然没有提及具体模型架构,但其暗示已针对 CPU 推理进行了优化。

用例涵盖语义/企业搜索、聊天机器人、AI 代理、文本提取、文档分类、命名实体识别、情感分析等。平台还支持 LLM 护栏、隐式反馈与 RLHF 以及企业单点登录——均为生产部署所必需。值得注意的是,来自 AWS 和一家全球系统集成商的推荐提到,在 AWS Graviton3 实例上性能提升 30-40%,RAG 系统准确率提升超过 20 个百分点。这为其声明增添了可信度,但网站上未提供独立基准测试。

在测试假设工作流程时,开发者很可能自带数据,通过 Compose 选项卡应用 AI 任务,部署到自己的 VPC 或本地环境,然后利用行为反馈日志进行定制。平台似乎涵盖了整个 MLOps 流水线,但未经实际操作验证,我无法确认其延迟、易用性或准确性结果。

定价与市场定位

网站上未公开定价。唯一的行动号召是预约咨询或申请演示,表明采用定制企业级定价模式。这在基础设施级 AI 平台中很常见,但限制了比价。竞品包括用于构建 RAG 应用的 LangChain 或 LlamaIndex 等框架,以及 Azure AI 或 Amazon Bedrock 等托管服务。然而,ThirdAI 的独特卖点是消除 GPU 依赖,这直接与需要昂贵硬件的解决方案竞争。从定位来看,他们瞄准的是优先考虑数据隐私、成本控制和部署灵活性的企业。

像 Hugging Face 的推理端点或 Replicate 等替代平台提供基于 GPU 的大规模推理,但 ThirdAI 认为其纯 CPU 方案可实现 100 倍的性价比。没有公开定价或基准测试,很难验证这一说法,但如果属实,它可能会颠覆当前的 AI 部署格局。

谁应该使用 ThirdAI?

ThirdAI 最适合那些需要部署 AI 应用且对数据隐私有严格要求(气隙部署)、希望避免 GPU 成本和复杂性、并拥有专门基础设施团队的企业。金融、医疗或政府领域的大型组织可能获益良多。无代码界面也使其适合没有深厚 ML 专业知识团队,正如一位首席工程师的推荐所述:他们迅速实现了市场落地。

另一方面,个人开发者、预算紧张的初创公司或希望免费试用的用户,可能会因缺乏公开定价和自助上手而感到门槛。如果你需要快速实验或利用 GPU 扩展能力,Ollama 或本地 LLM 框架等工具可能更实用。此外,平台对其专有技术的依赖可能导致锁定,不过 Extend 功能提供了一定程度的自定义空间。

总而言之,ThirdAI 为寻求在 CPU 上实现私有、低成本 AI 部署的企业提供了极具吸引力的价值主张。其声明得到了知名推荐的支持,但仍需独立验证。我建议任何优先考虑安全性和成本、而非追求最新模型自由度的组织尝试使用。

请访问 ThirdAI 官网 https://thirdai.com/ 自行探索。

评论